Googleの最新AI「Gemini」アプリ新機能の全貌:無料で試せる先進機能とは

Googleのパワフルな人工知能アシスタント「Gemini」に大規模なアップデートが実施されました。

2.0 Flash Thinkingの強化、Deep Researchの一般提供開始、パーソナライゼーション機能の追加など、多くの注目すべき新機能が登場しています。

これらの機能は多くのユーザーが無料で試すことができるようになりました。

進化した「2.0 Flash Thinking Experimental」の新機能

Googleは「Gemini」の中核となるAIモデル「2.0 Flash Thinking Experimental」の大幅なアップグレードを開始しました。このモデルは、ユーザーの質問やリクエストを一連のステップに分解して処理することで、より強力な推論能力を発揮し、質の高い回答を提供します。今回のアップデートでは、効率性と処理速度が改善されただけでなく、ファイルアップロード機能も追加されました。

Gemini Advancedユーザー向けの大容量コンテキストウィンドウ

特筆すべき点として、Gemini Advancedユーザーは「2.0 Flash Thinking Experimental」モデルで100万トークン(約100万語に相当)のコンテキストウィンドウにアクセスできるようになりました。

この拡張により、ユーザーは膨大な情報を探索・分析しながら、これまで以上に複雑な問題を解決することが可能になります。大量のテキストデータを一度に処理できることで、長文の書類や複数の資料を同時に分析するようなタスクが劇的に効率化されるでしょう。

「Deep Research」機能の一般提供開始

昨年12月に先行導入された「Deep Research」機能は、個人専用のAIリサーチアシスタントとして注目を集めてきました。この機能はウェブ全体から情報を検索・統合して数分でまとめ上げ、通常であれば何時間もかかる調査作業を大幅に効率化します。また、ユーザーが自力では見つけられなかったような情報源の発見にも役立ちます。

「2.0 Flash Thinking」による機能強化

今回、「Deep Research」は「Gemini 2.0 Flash Thinking Experimental」モデルと統合されることで大幅に強化されました。この連携により、調査の計画立案から検索、推論、分析、レポート作成に至るまで、研究のあらゆる段階でGeminiの能力が向上しています。より詳細で洞察に富んだ複数ページのレポートが作成できるようになり、質の高い調査結果が得られるようになりました。

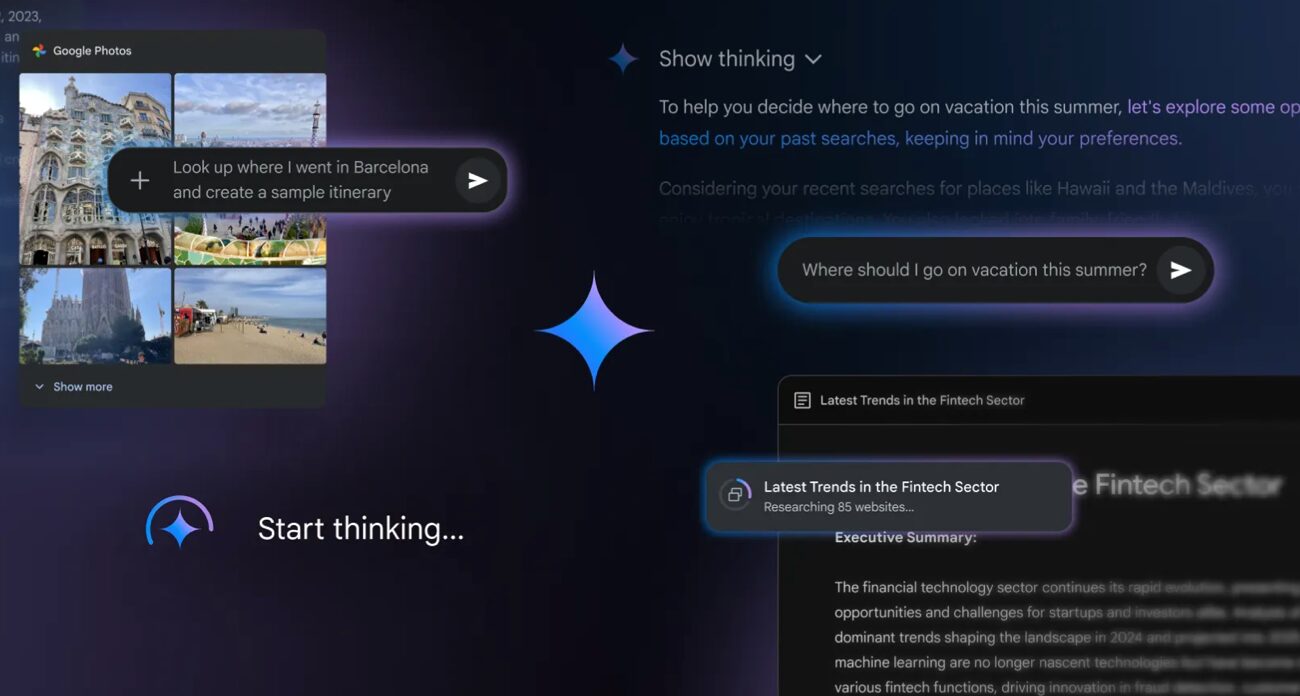

特筆すべき新機能として、Geminiがウェブを閲覧している間に自身の思考プロセスをリアルタイムで表示する機能が追加されました。これにより、ユーザーはAIがどのように調査タスクを進めているかを直接観察できるようになります。Deep ResearchとFlash Thinkingモデルの組み合わせにより、レポートの品質は今後もさらに向上していくことが期待されています。

グローバル展開と利用条件

「Deep Research」機能は現在、全世界で45言語以上に対応して展開されています。通常の「Gemini」ユーザーは無料で月に数回この機能を試すことができ、「Gemini Advanced」ユーザーはより広範囲にアクセスできるため、複雑なプロジェクトの時間節約に大いに役立てることができます。

この機能を利用するには、新しいプロンプトバーまたはモデルドロップダウンから「Deep Research」を選択するだけです。

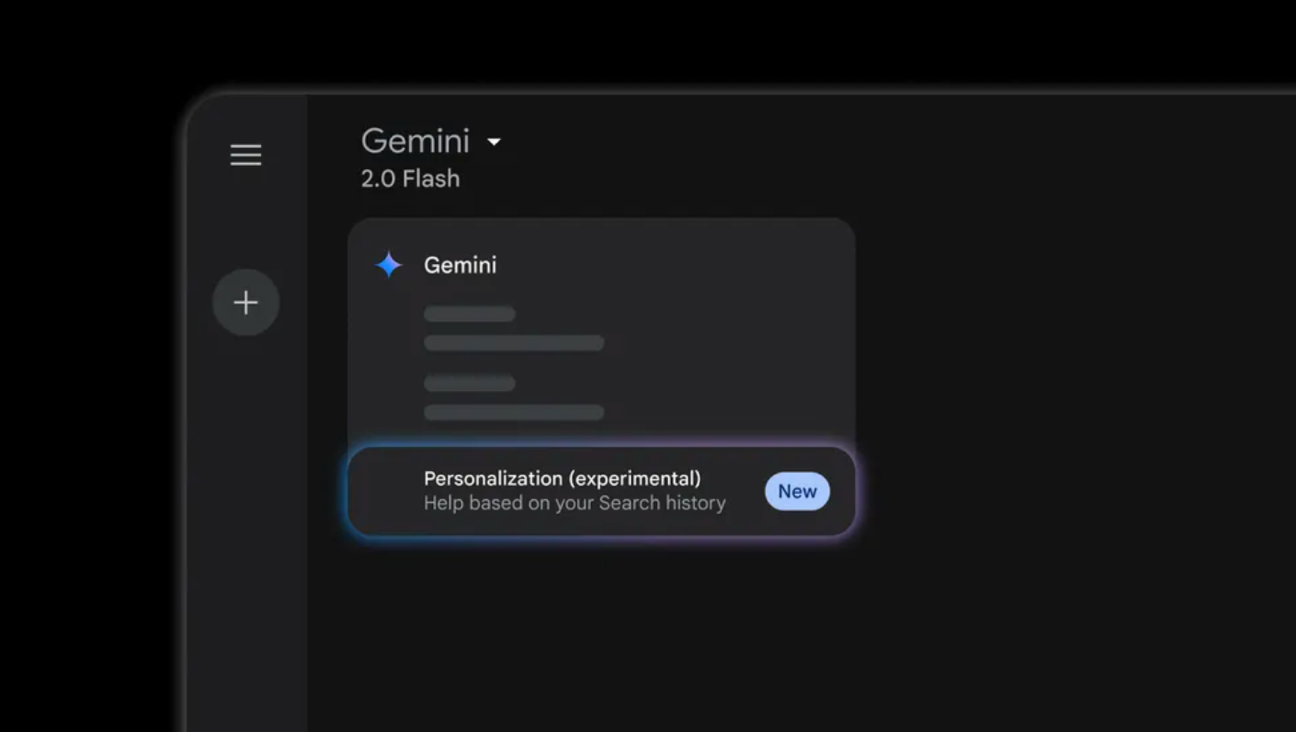

パーソナライゼーション機能の導入

Geminiは単なる便利なアシスタントではなく、ユーザーを理解し、すべてのやり取りをユーザーに合わせて調整する個人専用のAIパワードアシスタントとしての役割を強化しています。今回、「Gemini 2.0 Flash Thinking Experimental」モデルを基盤とした「パーソナライゼーション」と呼ばれる実験的な新機能が追加されました。

Googleのアプリやサービスとの連携

パーソナライゼーション機能により、GeminiはGoogleのアプリやサービス(当初はGoogle検索から開始)と連携して、ユーザーの個々のニーズにさらに合わせた応答を提供できるようになりました。

例えば、レストランのおすすめを尋ねると、Geminiはユーザーの最近の食べ物関連の検索を参照します。また、旅行のアドバイスを求めると、以前に検索した目的地に基づいて回答を提供します。

この機能を有効にするには、モデルドロップダウンから「Personalization (experimental)」を選択します。ユーザーは常に自分の検索履歴をコントロールでき、有効にした後でもGeminiから切断することができます。これにより、プライバシーを保ちながらもパーソナライズされた体験を得ることができるのです。

連携アプリの機能強化

Geminiが個人的なAIアシスタントとして魅力的な点の一つは、ユーザーがすでに利用しているGoogleのアプリやサービスにアクセスできることです。今回、英語版では、Geminiと連携する追加のアプリ(カレンダー、メモ、タスク、写真など)が「2.0 Flash Thinking Experimental」モデルで利用できるようになりました。

複数アプリを横断する複雑なリクエストへの対応

この思考モデルを使用することで、Geminiは複数のアプリを含む複雑なリクエストをより効果的に処理できるようになりました。新しいモデルは全体的なリクエストをより適切に推論し、それを個別のステップに分解して、進行状況を自己評価しながら処理を進めることができます。例えば、一つのプロンプトで「YouTubeで簡単なクッキーのレシピを探して、材料をショッピングリストに追加し、近くでまだ営業中の食料品店を見つけて」というような複合的な依頼が可能になります。

Google写真との連携(近日公開)

今後数週間のうちに、Geminiが操作できるアプリのリストに「Google写真」が追加される予定です。これにより、ユーザーは自分の写真に基づいて簡単に助けを求めることができるようになります。

例えば、Geminiは最近の旅行の写真を見て、訪れた場所に基づいて旅行の行程表を作成したり、運転免許証の有効期限がいつ切れるかなどの情報を思い出したりすることができます。

「Gems」機能の一般提供開始

「Gems」機能を使用すると、任意のトピックに関する独自の個人的なAIエキスパートを作成してGeminiをカスタマイズできます。この機能は現在、Geminiアプリで無料で展開され始めています。あらかじめ用意されたGemsのいずれかを使用するか、翻訳者、食事プランナー、数学コーチなど、独自のカスタムGemsをすぐに作成することができます。

カスタムGems作成方法

カスタムGemsを作成するには、デスクトップの「Gems manager」にアクセスし、指示を書き、名前を付けるだけで、好きなときにチャットすることができます。

また、カスタムGem作成時にファイルをアップロードすることもでき、さらに役立つ情報を参照できるようになります。これにより、特定の分野や目的に特化した独自のAIアシスタントを簡単に作成できるようになりました。

まとめ

2.0 Flash Thinkingモデルの強化、Deep Research機能の一般提供、パーソナライゼーション機能の追加、連携アプリの拡充、そしてGemsのカスタマイズ機能など、多くの革新的な機能が追加されました。

これらの機能は、gemini.google.comで試すことができます。

AIアシスタントの世界は急速に進化しており、Geminiの今回のアップデートはその最前線にあると言えるでしょう。

特に注目すべきは、多くの高度な機能が無料で試せるようになったことです。

個人の生産性向上やビジネスでの活用など、さまざまな場面でGeminiの新機能が役立つことでしょう。

(Via Google.)

LEAVE A REPLY