Anthropicが消費者に突きつける選択:クローズドな会話がAI訓練に使われる条件とは?

背景と問題提起

2025年8月28日に、AI開発企業のAnthropicは、チャットボットClaude(Free / Pro / Max各プラン)をお使いの皆さまに対して、会話やコーディングのやり取りをAIモデルのトレーニングに使用するかどうかを選べる新しいプライバシーポリシーを導入したと発表しました。

今回の変更では、特に操作をしない場合、初期設定のままで「トレーニングに使用する」に同意した扱いになります。対象ユーザーは2025年9月28日までに意思表示をすれば設定を見直せますが、何もしないと自動的に同意扱いになる点がポイントです。

従来は、消費者向けClaudeの会話データは原則として30日後に削除されていました(一部の例外を除きます)。しかし、ユーザーが明示的に許可した場合に限り、データの保存期間を最長5年間に延長できるようになりました。

これはAIの便利さを高めるチャンスである一方、プライバシーリスクが増える面もあるため、仕組みを丁寧に理解しておくことが大切です。

主な変化の仕組みとその意図

1. データ保存期間の延長

今回の方針では、新しく作成したチャットや再開した会話が主な対象です。過去に閉じたままの会話は、ユーザーが再度開かない限り対象になりません。保存期間を延ばす狙いは、AIモデルの安全性や推論精度、コーディング支援の品質などを継続的に高めるためです。

表面上は地味な変更に見えますが、学習に使える期間が長くなる分だけ、実世界の多様なやり取りをより深く反映できる可能性が広がるのがポイントです。

ユーザーにとっては、回答の精度が上がったり、長い文脈をまたいだサポートが改善されたりといったメリットが期待できます。一方で、個々の入力が長期にわたって企業の資産として活用されることになるため、どの範囲まで共有するかを各自で見極める必要があります。

2. 選択の仕組みと課題

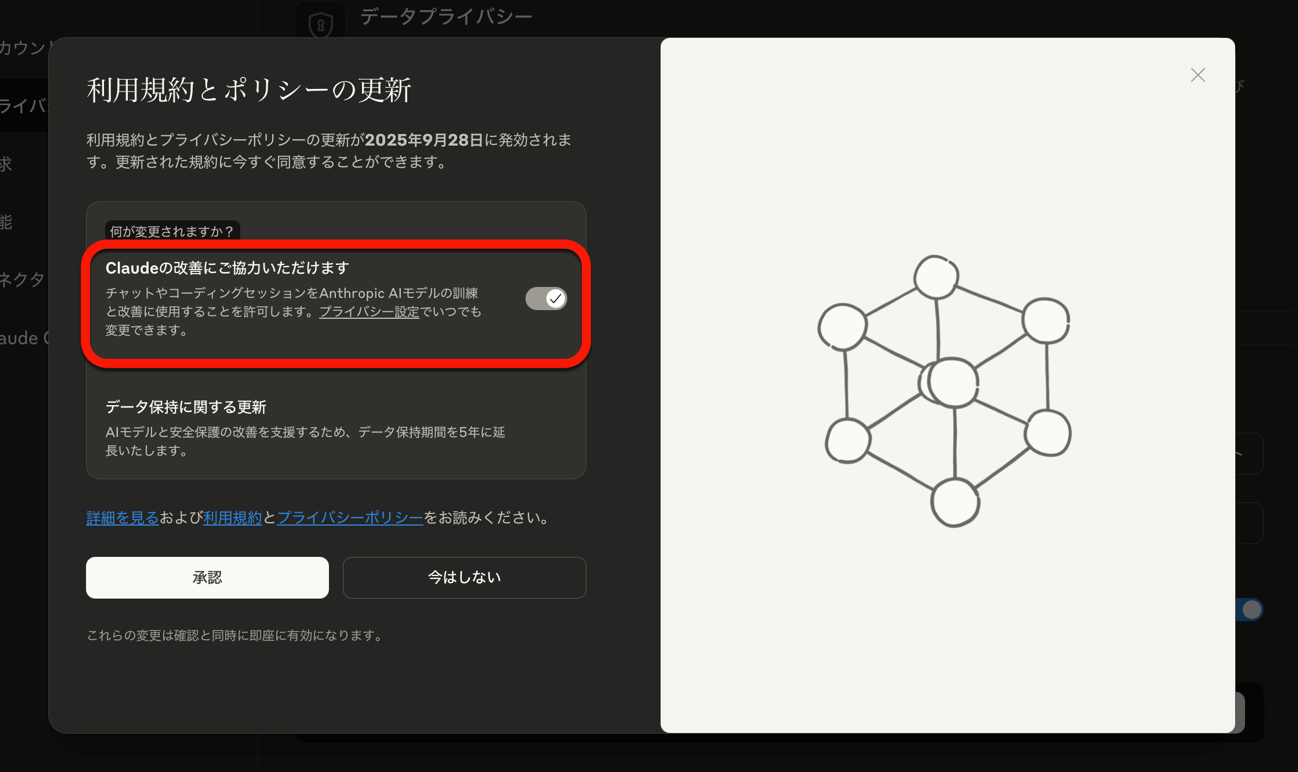

今回採用されている方式はオプトアウトです。つまり、明確に「使わない」と選ばない限り、原則として学習利用に同意したとみなされます。アプリやWeb上の同意画面では、更新された契約とプライバシーポリシーのポップアップが表示され、大きな「承認」ボタンと、設定の奥にある「Claudeの改善にご協力いただけます」トグルが登場します。何となくボタンを押してしまい、意図せず同意してしまうリスクがあるため、ここは慎重に確認したいところです。

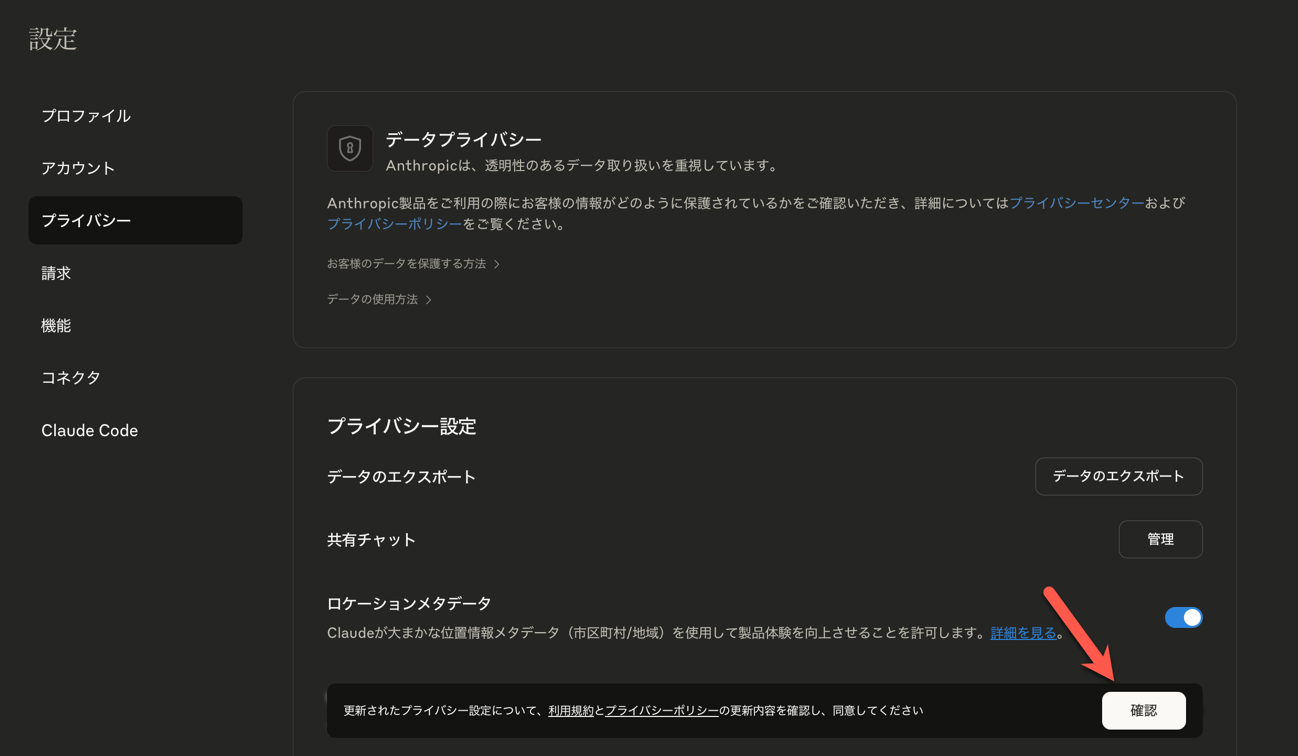

設定はいつでも変更できます。設定 > プライバシー > 確認ボタン > 「Claudeの改善にご協力いただけます」をオフにすれば、今後の会話が学習に使われることは止められます。

ただし、すでに学習に使われたデータを遡って取り消すことはできません。ここは不可逆なポイントですので、最初の選択時に「どの程度まで許可するか」を考えておくと安心です。

影響を受けるユーザー層と除外対象

今回のポリシーが適用されるのは、Claude Free / Pro / Max / Claude Codeなどの消費者向けプランです。一方で、企業・教育・政府向けプラン(Claude for Work / Education / Gov)や、API経由(Amazon BedrockやGoogle Cloud Vertex AIなど)の利用は対象外です。企業や公的機関は契約上の要件が厳しく、データの取り扱いも別枠で管理されるため、消費者向けと線引きされていると考えられます。

なぜ今、この変更を行ったのか?深層を探る

競争激化とデータ不足の解消

AIモデルの性能は、学習データの量と質に大きく左右されます。OpenAIやGoogle、Metaなどの先行企業が大規模な対話データを確保している中で、Anthropicも競争力を維持・向上するためには、多様かつ実用的な会話データの継続的な確保が欠かせません。保存期間の延長は、こうした現実的なニーズに応える施策だと捉えられます。

規制強化と透明性への対応

同時に、世界各地でAIとプライバシーに関する議論は加速しています。EUのAI Actをはじめ、米国の規制当局も同意取得の分かりやすさやデータの最小化を重視する姿勢を強めています。

オプトアウト設計はユーザーの選択を尊重しているように見えますが、実際には「気づかない同意」を招きやすい面もあります。だからこそ、説明の分かりやすさやUIの配慮がより一層重要になっているのです。

体験向上とプライバシーの綱引き

便利で頼れるAI体験を実現するには、多様な現実の会話から学ぶことが不可欠です。一方で、個人のプライバシーは後戻りしにくい性質を持ちます。

Anthropicの今回の変更は、この二つの価値の間で最適な折り合いを探る試みだといえます。ユーザーとしては、〈共有してよい情報〉と〈控えたい情報〉の線引きを自分ごととして考え、設定をコントロールしていく姿勢が求められます。

構造化した解説

政策変更の全体像

- 従来の30日保存から、最長5年保存へ延長できるようになったことです。

- 対象は消費者向けプランで、企業・教育・政府・APIは除外です。

- 選択方式はオプトアウトで、意思表示の期限は2025年9月28日です。

- 設定でいつでも変更できますが、過去に学習へ利用された分は取り消せません。

ユーザーに求められる行動

- まずは同意画面や設定の状態を確認するのがおすすめです。

- 学習利用を止めたい場合は、設定 > プライバシー > 確認ボタン > 「Claudeの改善にご協力いただけます」をオフにします。

- 業務・機密情報・個人を特定できる情報は、許可の有無にかかわらず入力を控えると安心です。

背景にある企業の思惑

- 性能向上のための学習データ確保は、いまや業界全体の最重要課題です。

- 安全性向上(有害出力の抑制や誤情報の軽減)にも実データが有効です。

- 規制対応とユーザー信頼の両立には、わかりやすい説明と選択肢の提示が欠かせません。

ユーザーが留意すべきポイント

- 「気づかない同意」を避けるため、初回ポップアップや設定を必ず確認します。

- 長期保存が前提になりうるため、センシティブ情報の入力は控えるのが無難です。

- 学習利用のオン/オフは将来の会話に反映されますが、過去の学習分は戻せません。

要点まとめ

- 変更内容: デフォルトで会話データを学習に利用可能になり、保存は最長5年です。

- ユーザーの行動: 2025年9月28日までに設定を確認し、不要ならオプトアウトします。

- 除外対象: 企業・教育・政府・API経由の利用は本変更の対象外です。

- 背景: データ獲得競争と性能・安全性向上のための取り組みが進んでいます。

- 留意点: UI設計による意図せぬ同意や、過去データの不可逆性に注意が必要です。

LEAVE A REPLY