話し言葉でメモ、書き言葉でメール。無料で使えるMacの音声入力『TypeWhisper』

まいど、酔いどれです。

突然ですが、長時間キーボードを打ち続けた後の、あの指先の疲れ、分かりますか。ブログを書いて、AIとチャットして、またブログを書いて。気づいたら一日中キーボードを叩いている、なんてこと、Macをよく使う方なら一度は経験されているんやないかと思います。

私もそれがずっと悩みでした。思考のスピードに指が付いてこない。いいアイデアが浮かんでいるのに、打っている途中で消えていく。そこで本腰を入れて取り組んだのが音声入力です。

Aqua Voice、Speakly、Typeless、Codexと、気になるアプリを片っ端から試してきました。それぞれにお金を払ったり、設定に時間を使ったり。そうして最終的にたどり着いたのが、今回紹介するTypeWhisper(タイプウィスパー)です。

結論を先に言うと「完全無料、インターネット不要、Macの中だけで動く」この3点が決め手でした。ただし、インストールには正直かなり手間がかかりました。私は設定に1日以上使いましたし、ダウンロードだけで1日無駄にしたこともあります。

この記事では、その失敗も含めてすべてお伝えします。同じ轍を踏まないように、ぜひ最後まで読んでみてください。

この記事で分かること

・TypeWhisperが4つの有料アプリより優れていた理由(実体験比較)

・「話した通りに出てこない」問題の原因と対処法

・WhisperKitモデルの選び方と、ダウンロードで失敗しないコツ

・全設定項目の解説(General〜Advanced)

・Raycast、Keyboard Maestroとの自動化連携

1. TypeWhisperとは何か

TypeWhisperは、macOS専用(Windows版はベータ版・iOSはα版)のオープンソース音声入力・文字起こしアプリです。開発者がGitHubで公開しており、誰でも無料で使えます。

特徴をひとことで言うなら「Macの中だけで完結する、完全無料の音声入力環境」です。音声データがインターネットに送信されることがないので、プライバシーの面でも安心して使えます。仕事の機密事項を話しても、個人的なメモを声に出しても、すべて自分のMacの中で処理されます。

搭載エンジンは2種類あります。

Apple SpeechはmacOS標準の音声認識エンジンです。追加ダウンロード不要で、軽量かつ即応答。手軽に使い始めるには最適です。

WhisperKitはOpenAIのWhisperモデルをApple Silicon向けに最適化したエンジンです。精度が格段に高く、日本語の認識も非常に自然です。ただし別途モデルのダウンロードが必要で、ここに少し手間がかかります。詳しくは第4章で解説します。

2. 4つのアプリを渡り歩いた実体験と比較

TypeWhisperにたどり着くまでに使ってきたアプリについて、正直にお伝えします。どれも「悪いアプリ」というわけではありません。ただ、私の使い方には合わなかった、ということです。

Aqua Voice

クラウド処理による低遅延が売りのアプリです。動いているときのスピードは本当に速くて、最初は感動しました。ところが有料であることに加えて、夕方や夜の時間帯になるとサーバーが混雑するのか、体感できるほど遅くなることがありました。ちょうど使いたい時間帯に遅い、というのが一番困りました。

Speakly

私はGensparkのサブスクリプションに含まれていたため無料で使えていました。機能としては悪くないのですが、Genspark契約者以外には有料になるため、誰にでもお勧めできる選択肢ではありません。

Typeless

4つのなかで一番気に入っていたアプリです。AIによる清書機能が強力で、話し言葉を自然な書き言葉に整えてくれる。使い心地も洗練されていて、しばらくメインで使っていました。ただやはりクラウド処理なので、時間帯によっては遅延が発生することがありました。結局これがどうしても解消できず、離れることになりました。

Codex

OpenAIのCodexアプリに搭載された音声入力機能です。ホットキーで呼び出せる手軽さは魅力なのですが、Codexを起動したままにしておかないと使えないという仕様があります。さらに、GitHubの公式issueで複数の報告が確認されているのですが、最新バージョンではメモリを6GB以上消費する問題があります。常駐させておくには重すぎると判断しました。

4アプリ+TypeWhisper 比較表

| アプリ | 費用 | 処理方式 | 実際に感じた問題 |

|---|---|---|---|

| TypeWhisper | 完全無料 | ローカル | 設定に慣れが必要 |

| Aqua Voice | 有料 | クラウド | 時間帯によって遅延あり |

| Speakly | Genspark契約者のみ無料 | クラウド | 単体利用は有料 |

| Typeless | 有料(無料枠あり) | クラウド | 時間帯によって遅延あり |

| Codex(音声入力機能) | ChatGPT契約が必要 | クラウド | 起動必須+メモリ6GB超消費 |

クラウド処理のアプリに共通する問題は「いつ遅くなるか分からない」という点です。TypeWhisperはローカル処理なので、この問題が根本的に存在しません。夜中の2時に使おうが、サーバー事情に振り回されることがないのです。

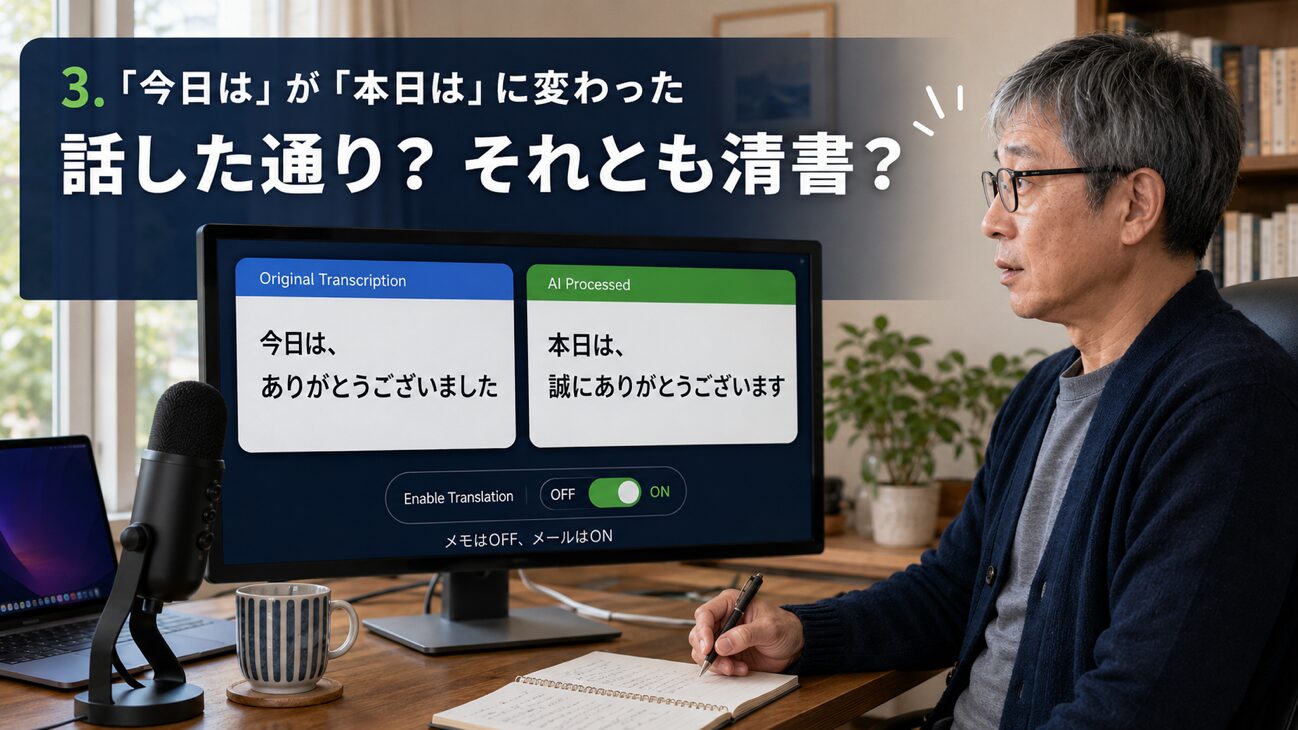

3.「今日は」が「本日は」に変わった。TypeWhisperの自動整形機能を理解する

TypeWhisperを使い始めた当初、不思議なことが起きました。

「今日は、お誘いいただきありがとうございました。大変有意義な時間を過ごすことができました、本当にありがとうございました」と話したのに、入力されたのは全然違う文章だったんです。

本日はご招待いただき、ありがとうございます。とても有意義な時間を過ごすことができました。誠にありがとうございます。

話し言葉が勝手に丁寧な書き言葉に変換されていました。「今日は」が「本日は」に、「ありがとうございました」の重複がスッキリ整理されて「誠にありがとうございます」に。AIが気を利かせすぎたわけです。

原因はHistoryタブで確認できました。履歴を見ると「Original Transcription(生の文字起こし)」と「AI Processed(AI加工後)」の2つが並んで記録されていて、Originalには話した通りの言葉が残っていました。つまり認識自体は正確で、その後AIが勝手に書き直していたのです。

犯人はGeneral設定の「Enable Translation」でした。日本語から日本語であっても、このスイッチがオンになっていると、AIが「より適切な表現」に書き換えてしまいます。あわせてRecording設定の「App-aware formatting」も関係していて、使用中のアプリの種類に応じてAIが文体を判断します。

まずオフにするところから始める

General設定の「Enable translation」スイッチをオフにすると、話した通りの言葉がそのまま入力されます。最初はこの状態から使い始めることをお勧めします。

「お節介」を逆手に取る使い方

ただ、この機能は使い方によっては非常に強力な武器になります。

オフにしておく場面:自分用のメモ、AIとのチャット、アイデアの書き出し。口から出た言葉をそのままの温度で残したい時はオフが正解です。

オンにする場面:メール作成、ブログの清書、正式な文書。「えー」「あのー」といった口癖を消して、話し言葉を書き言葉に自動変換してくれます。口述して後から清書する、という手間が大幅に減ります。

理想の運用は、Keyboard Maestroのショートカットでオン/オフを瞬時に切り替えることです。「メモを取るマクロ」と「メールを書くマクロ」をそれぞれ用意しておけば、この「お節介機能」が最強の相棒に変わります。

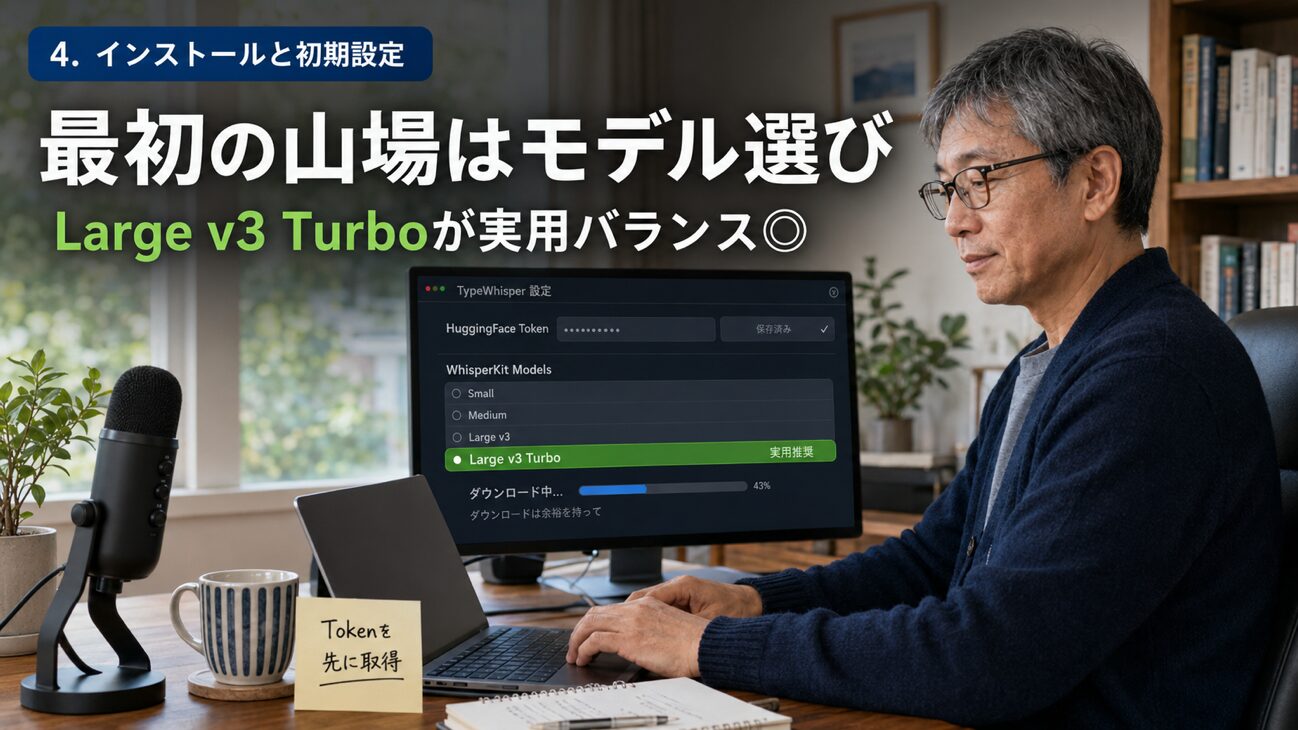

4. インストールと初期設定

ダウンロード

TypeWhisperはApp Storeからインストールできます。アプリ本体は無料です。インストール後すぐにApple Speechエンジンで音声入力を試すことができます。

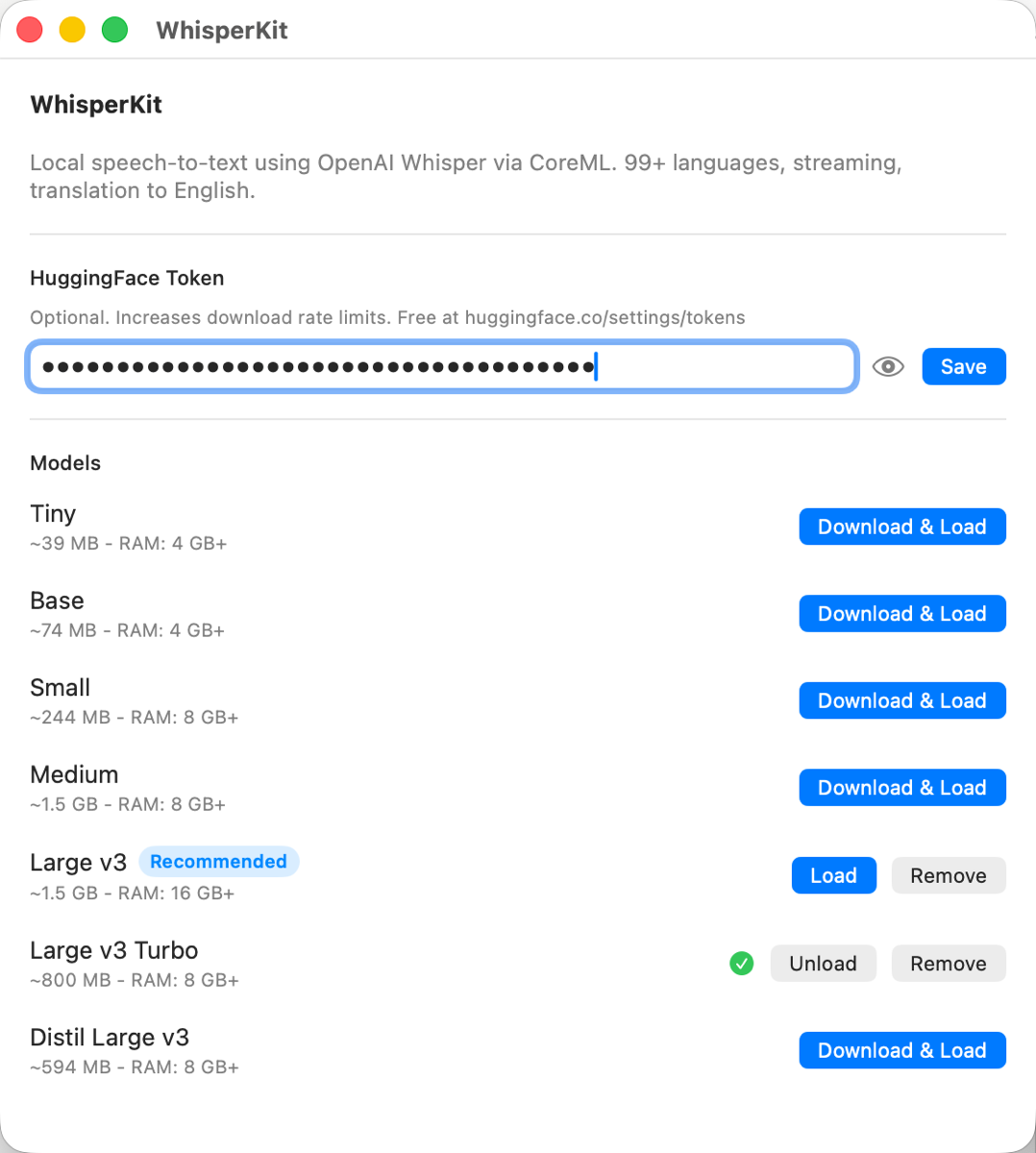

【必読】HuggingFace Tokenを先に取得する

WhisperKitのモデルをダウンロードしたいなら、先にHuggingFace Tokenを取得してください。これが最重要手順です。

TypeWhisperのIntegrations画面でWhisperKitを選択すると、「HuggingFace Token」という入力欄があります。説明文には「Optional(任意)」と書いてありますが、これを入れておかないとダウンロードのRate Limitが低く制限されるため、極めて時間がかかります。

Tokenは無料で取得できます。huggingface.co/settings/tokensにアクセスし、アカウントを作成してTokenを発行してください。発行したTokenをTypeWhisperのWhisperKit設定画面に貼り付けてSaveを押します。この一手間を惜しまないでください。

ダウンロードには余裕を持って臨む

正直に申し上げます。私はダウンロードに丸1日無駄にしました。

HuggingFace Token取得済みの状態でも、サーバーの混雑状況によっては何度もエラーが発生します。初日は何度試しても途中でエラーになり、結局ダウンロードできませんでした。翌日の午前中に改めて試したところ、時間はかかりましたが無事に完了しました。タイミング次第、としか言いようがありません。急ぎで導入しようとすると、痛い目を見ます。

WhisperKitモデルの選び方

WhisperKitには複数のモデルがあります。サイズが大きいほど精度が高く、当然ダウンロードにも時間がかかります。

| モデル | サイズ | 推奨RAM | 特徴 |

|---|---|---|---|

| Tiny | 約39MB | 4GB+ | 最軽量・速度優先 |

| Base | 約74MB | 4GB+ | 軽量・バランス型 |

| Small | 約244MB | 8GB+ | 速度と精度のバランス |

| Medium | 約1.5GB | 8GB+ | 高精度寄り |

| Large v3(アプリ推奨) | 約1.5GB | 16GB+ | 最高精度だが遅延あり |

| Large v3 Turbo(実用推奨) | 約800MB | 8GB+ | 精度と速度のバランスが最良 |

| Distil Large v3 | 約594MB | 8GB+ | Large v3の軽量版 |

アプリ上ではLarge v3に「Recommended」バッジが付いていますが、私の環境(M1 Max・メモリ64GB)では体感できる遅延がありました。実際に今使っているのはLarge v3 Turboです。話してから文字が出るまでのタイムラグがほとんどなく、思考を止めずに入力できます。ただし体感速度はMacのスペックに大きく左右されます。この記事はあくまで私の環境での話です。

ロードは1モデルのみ、切り替えに数分かかる

重要な仕様として、WhisperKitでロードできるモデルは常に1つだけです。別のモデルに切り替えるにはUnload→Loadの手順を踏む必要があり、この切り替えに数分かかります。場面に応じて気軽に切り替えながら使う、という運用は現実的ではありません。最初にどれを使うか1本に決めてしまうことをお勧めします。

初回起動のコンパイル待ちについて

WhisperKitは初回ロード時に、お使いのMacのApple Silicon向けに最適化するコンパイルが走ります。「少し時間がかかった」と感じるかもしれませんが、これは一度だけです。2回目以降はスムーズに起動します。

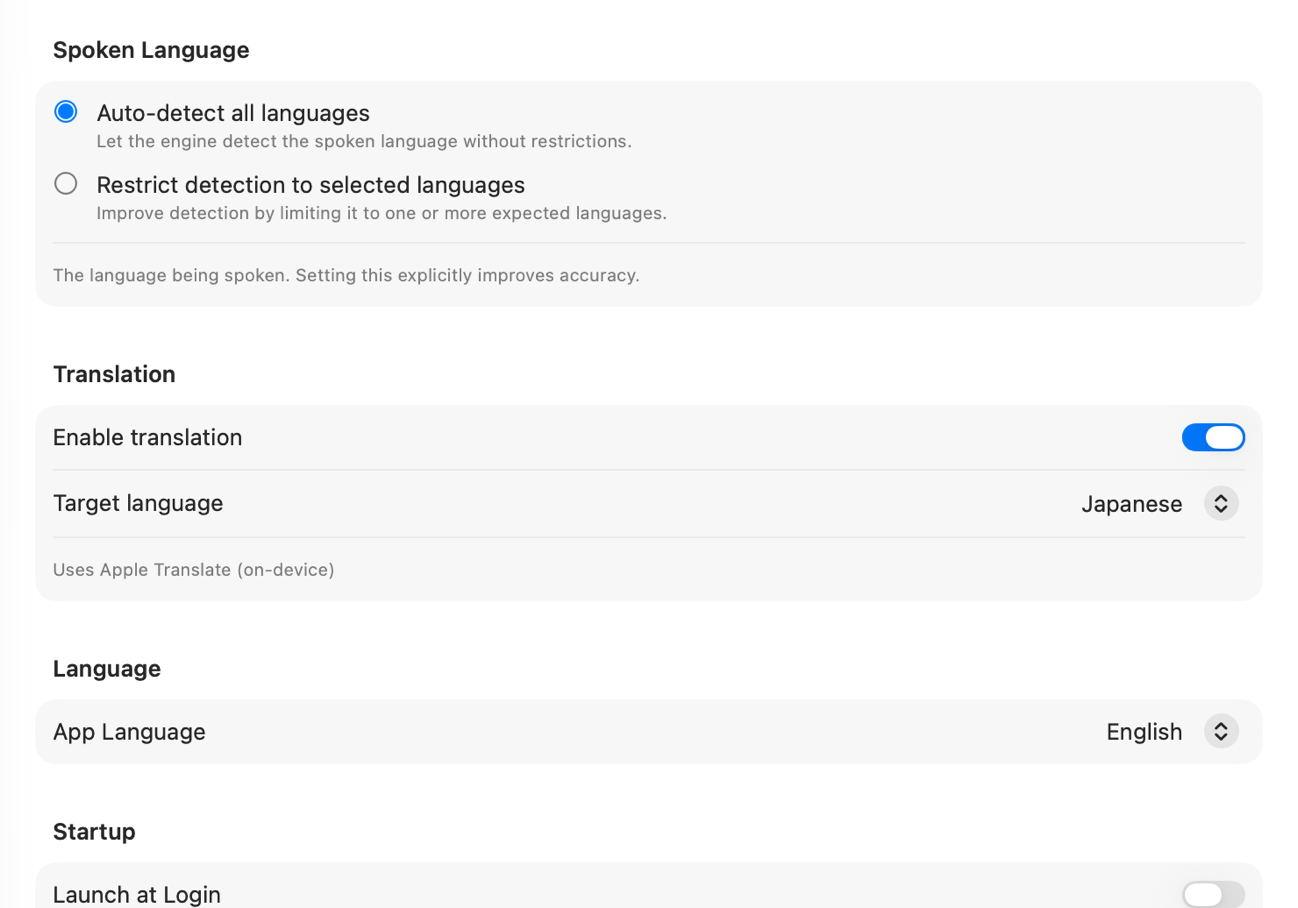

言語はJapaneseに固定することを推奨

General設定の「Spoken Language」はデフォルトで「Auto-detect all languages」になっていますが、「Restrict detection to selected languages」に変更してJapaneseのみに固定することをお勧めします。Auto-detectのままだと、録音開始直後の無音区間で言語判定に失敗して認識が始まらないことがあります。

5. 設定項目 完全解説

TypeWhisperの設定画面は項目が多く、最初は少し戸惑います。ここでは各項目を順に解説します。

5-1. General(一般設定)

Spoken Language(話者の言語):音声認識の言語を設定します。「Auto-detect all languages」はすべての言語を自動判別しますが、前述の通り日本語専用に固定することを推奨します。「Restrict detection to selected languages」を選び、Japaneseにチェックを入れます。

Translation(翻訳):第3章で詳しく解説した「口語→文語変換」の機能です。「Enable translation」スイッチがここにあります。Target languageはJapaneseを選択します。Apple のオンデバイス翻訳を使用するためデータがクラウドに送信されません。

App Language(アプリの言語):TypeWhisper自体のメニューや設定画面の表示言語です。日本語化はされていないためEnglishのままになります。

Launch at Login(ログイン時に起動):Mac起動時にTypeWhisperを自動で立ち上げる設定です。常用する場合はオンにしておくと便利です。

Indicator(インジケーター):録音中に画面上に表示されるステータス表示のデザインを選べます。MacBookのノッチ部分を活用する「Notch」スタイル、画面上に浮かぶ「Overlay」スタイル、最小限の「Indicator」スタイルがあります。外部ディスプレイをメインにしている場合はOverlayが使いやすいです。Notchスタイルを選んだ場合、録音中のテキストをリアルタイムでノッチ部分に表示する「Show live transcript preview」機能も設定できます。

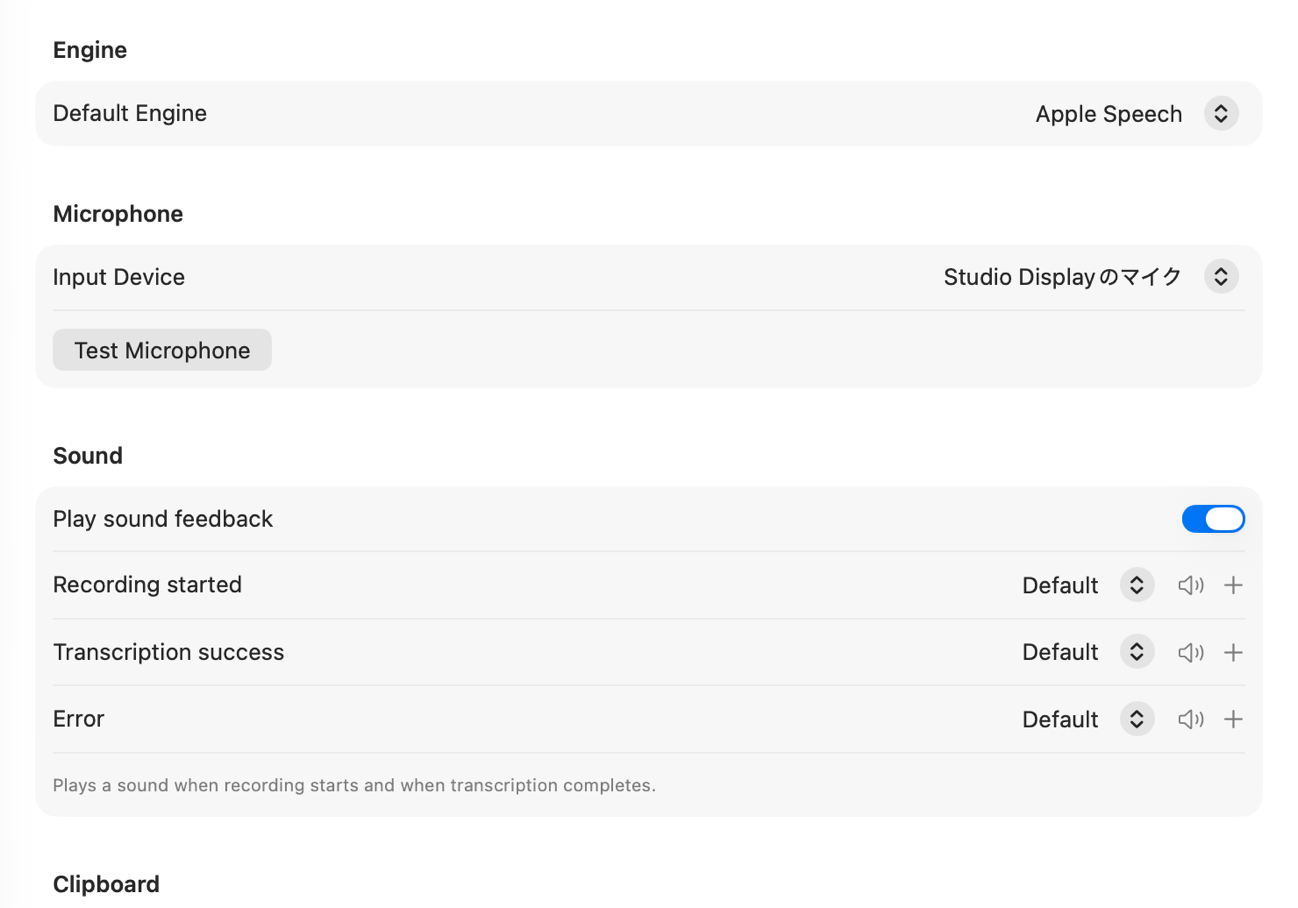

5-2. Recording(録音設定)

Default Engine(エンジン):音声認識に使うメインエンジンをApple SpeechかWhisperKitから選びます。精度を求めるならWhisperKit+Large v3 Turboの組み合わせです。Apple Speechは軽量で応答が速いため、手軽なメモ用途には十分です。

Input Device(マイク選択):録音に使うマイクを指定します。MacBook内蔵マイクより外部マイクやStudio Displayのマイクの方が収音性能が高く、認識精度にも影響します。「Test Microphone」ボタンで動作確認ができます。

Play sound feedback(通知音):録音開始時、文字起こし完了時、エラー時のそれぞれに通知音を設定できます。音で状態を把握したい方はオンにしておくと安心です。

Preserve clipboard content(クリップボード保護):オンにすると、文字起こし後にクリップボードが録音前の状態に復元されます。コピーしていた大事なテキストを上書きしたくない場合に便利です。

App-aware formatting(アプリに応じた整形):送り先のアプリに応じてAIが自動的に文体を整える機能です。メールアプリでは丁寧な文体に、コードエディタではフォーマットを維持するように動きます。意図しない変換が起きる場合はオフにします。

Audio Ducking(音量自動調整):録音中だけシステム全体の音量を下げる機能です。BGMやYouTubeの音がマイクに入り込んで精度が落ちるのを防ぎます。

Media Pause(メディア一時停止):録音を開始すると再生中の音楽や動画を自動で一時停止し、録音終了後に再開します。

5-3. Recorder(レコーダー)

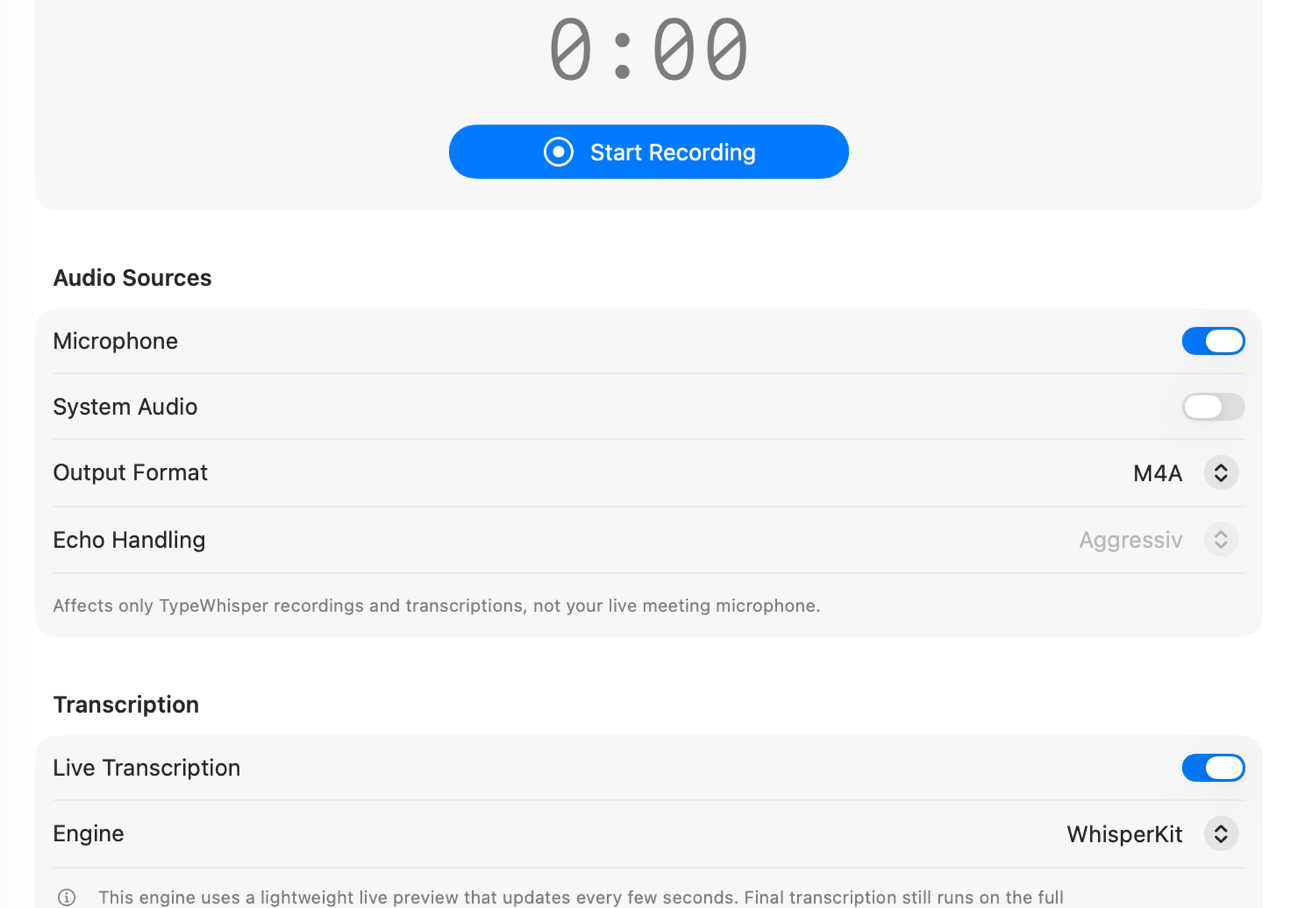

リアルタイム録音を行うメインパネルです。中央の「Start Recording」ボタンを押すと録音が始まります。

Audio Sources(音源設定):MicrophoneとSystem Audioのオン/オフを切り替えられます。Microphoneは自分の声、System AudioはMac内部で鳴っている音(会議相手の声やYouTubeの音など)を拾う設定です。オンライン会議で相手の声も文字起こししたい場合はSystem Audioをオンにします。なおこの設定はZoomなどの会議アプリ側のマイク設定には影響しません。

Live Transcription(リアルタイム文字起こし):録音中にリアルタイムで文字起こしを表示するかどうかを切り替えます。オンにしておくと話しながら認識状況を確認できます。

録音済みファイルの履歴もここで確認できます。

5-4. File Transcription(ファイル文字起こし)

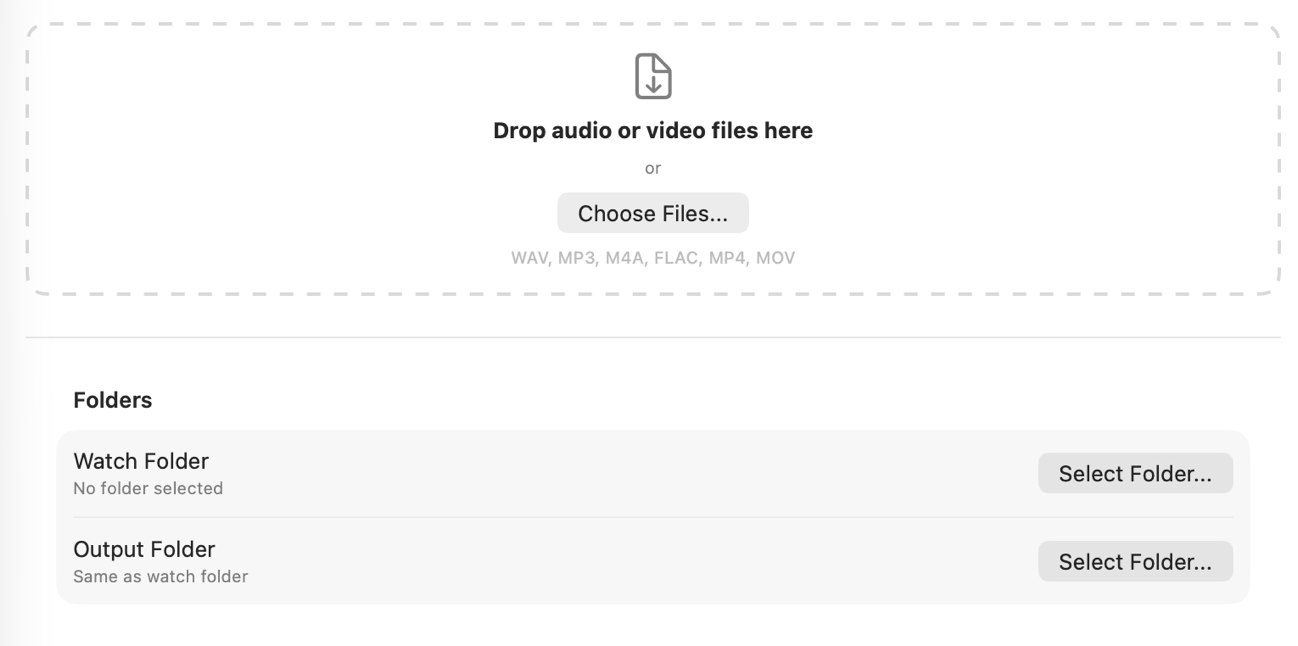

保存済みの音声・動画ファイルを読み込んでテキスト化する機能です。WAV、MP3、M4A、FLACの音声ファイルに加え、MP4、MOVの動画ファイルにも対応しています。ファイルをドラッグ&ドロップするか「Choose Files…」ボタンから選択します。

Watch Folder(監視フォルダー):特定のフォルダーを監視して、ファイルが追加されたら自動で文字起こしを実行する機能です。iPhoneのボイスメモを特定のフォルダーに移動するだけで、帰宅後に自動処理が始まるような運用が組めます。

Output Format(出力形式):書き出すファイルの形式を選べます。Markdown(.md)を選んでおくとObsidianへそのまま取り込めます。

なお、この機能についてはまだ実際に使っていないため、詳細なレポートは使い込んだ後に改めてお伝えします。

5-5. Dictionary(辞書)

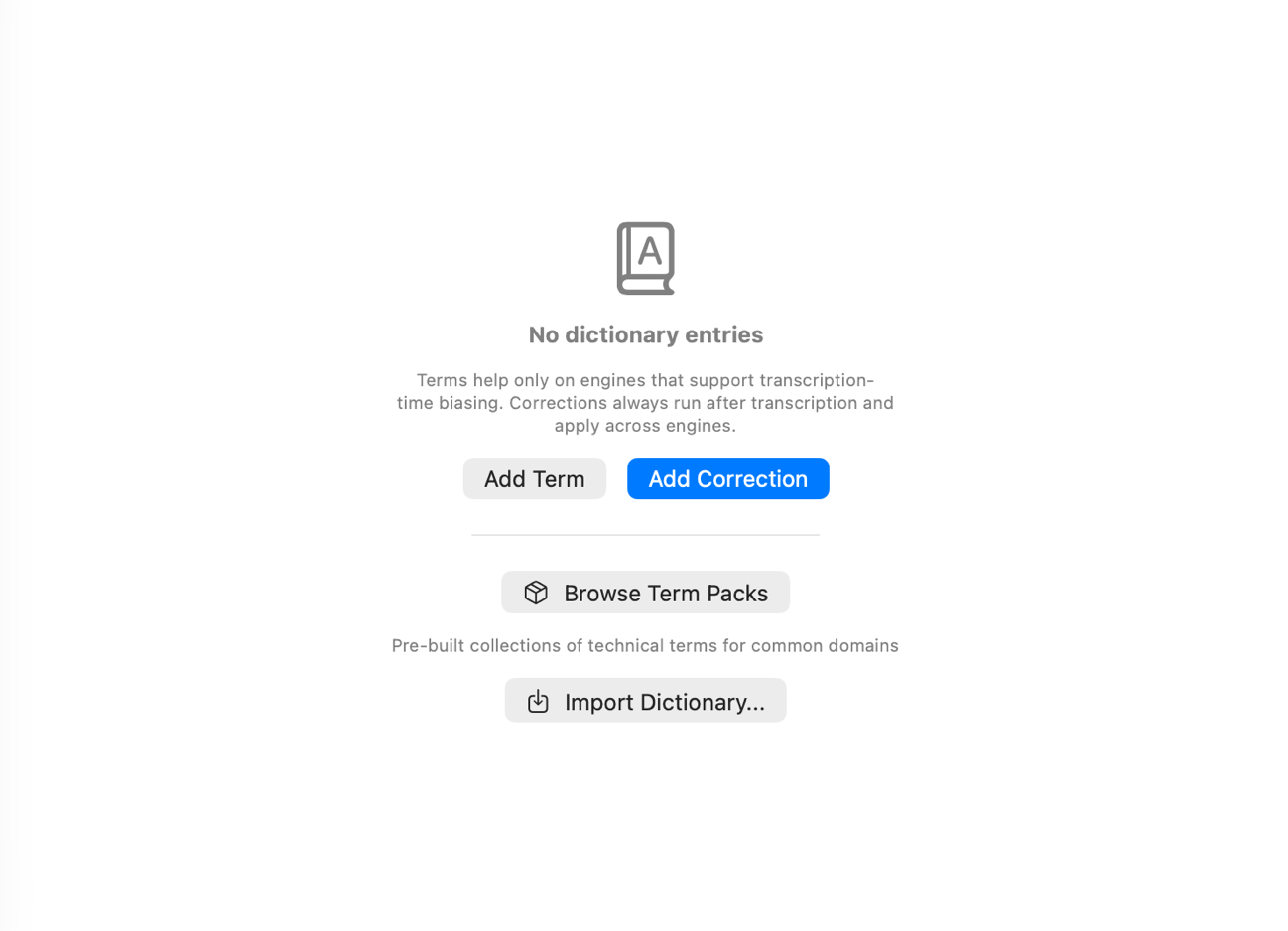

Add Term(単語の追加):AIに優先的に認識させたい専門用語や固有名詞を登録します。通常のAIが聞き間違えそうなニッチな用語、独特な読み方をする製品名など、よく使う言葉を登録しておくと認識精度が上がります。

Add Correction(修正ルールの追加):「AというミスをBに自動修正する」という置換ルールを作成します。どのエンジンを使っていても文字起こし後に適用されるため、よくある誤変換を登録しておくだけで後処理が大幅に楽になります。

「Browse Term Packs」からIT・医療・法務などの分野別用語パックを導入したり、「Import Dictionary」でCSV形式の用語リストを一括インポートしたりすることもできます。

5-6. Snippets(スニペット)

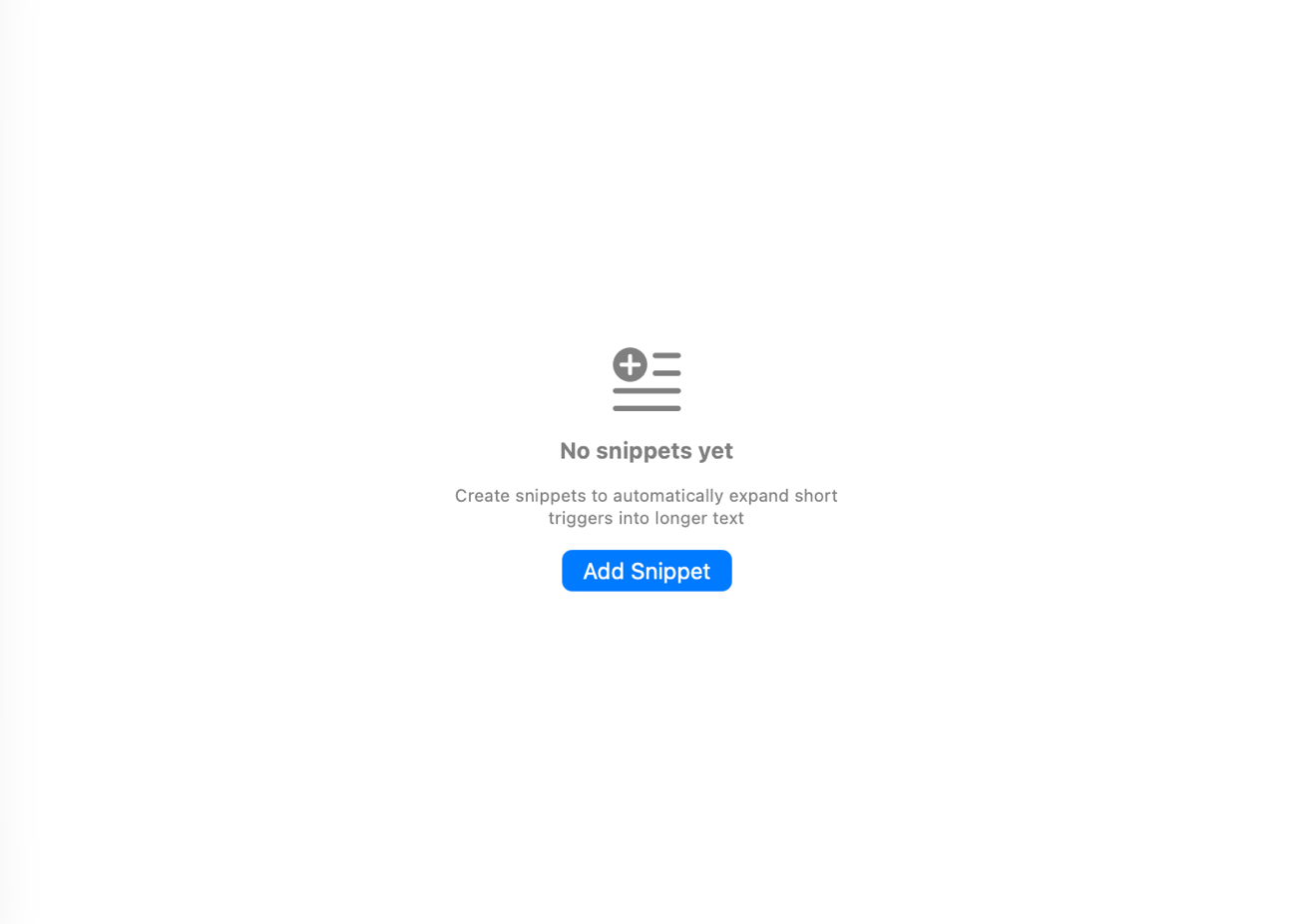

短いキーワードを入力するだけで、あらかじめ登録した長い定型文に自動展開される機能です。「Add Snippet」ボタンからトリガーとなるキーワードと、展開される文章のペアを登録します。

例えば「;sig」と入力するだけで自分のブログURLを含んだ署名文が展開される、といった使い方ができます。ブログの締め文、SNSへの誘導文、よく使うHTMLタグなど、繰り返し入力するものを登録しておくと執筆速度が上がります。辞書がAIの認識精度を上げるためのものなら、スニペットは入力の手間を省いて執筆速度を上げるためのツールです。

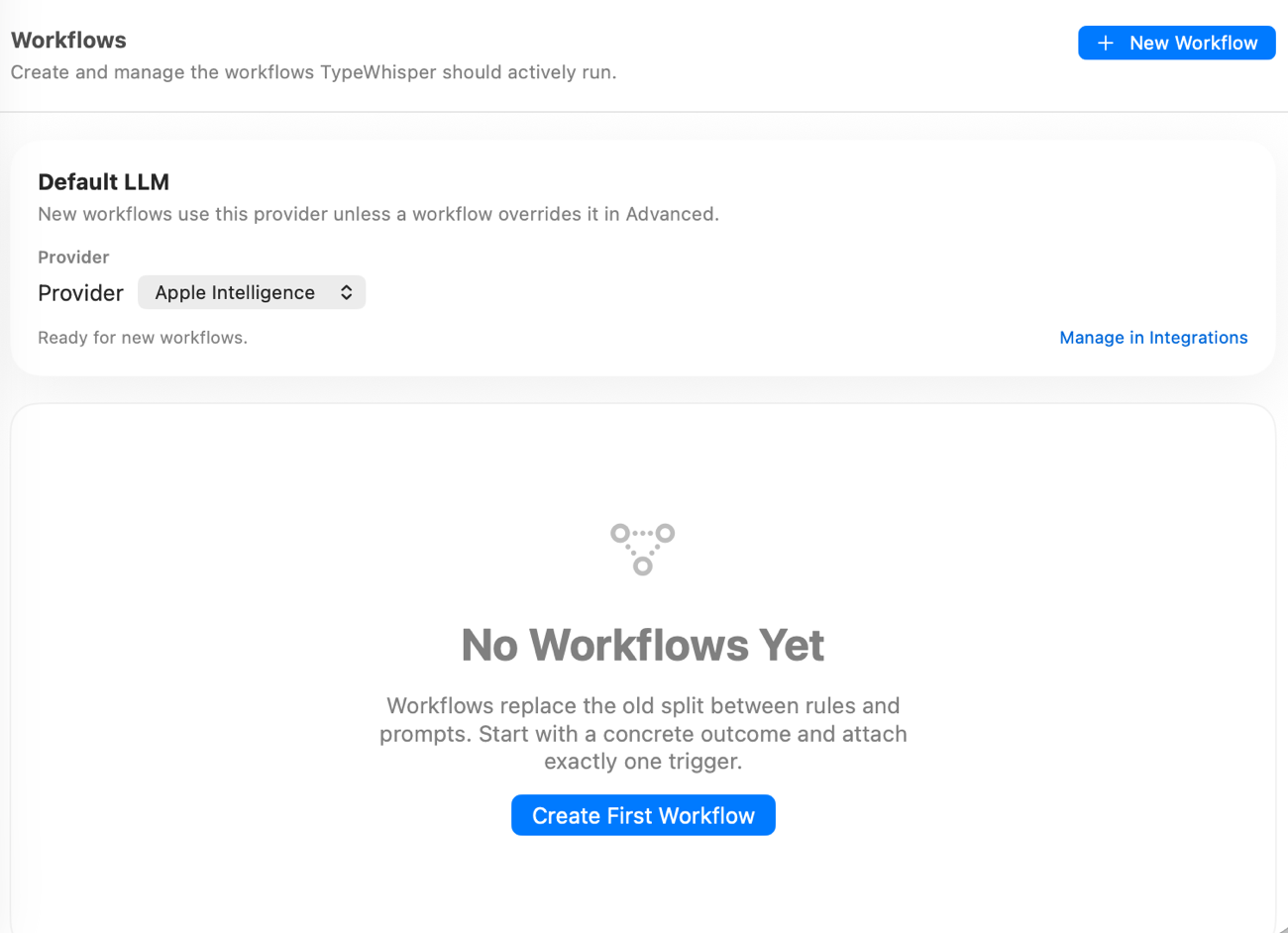

5-7. Workflows(ワークフロー)

文字起こし後のテキストに対してAIが自動処理を実行する仕組みを作成・管理します。「何をきっかけに(Trigger)」「どういう結果を出すか(Outcome)」を1対1で組み合わせてワークフローを作ります。

Default LLMにはApple Intelligenceが設定されています。外部のLLM(Gemini、Claude、ChatGPTなど)をIntegrationsで連携させておけば、そちらを使うことも可能です。

活用例としては「録音が終わった瞬間に3行で要約してクリップボードにコピー」「話し言葉をMarkdown形式のブログ下書きに整える」「YouTube用のタイトル案とチャプター構成を自動生成する」といったものが考えられます。

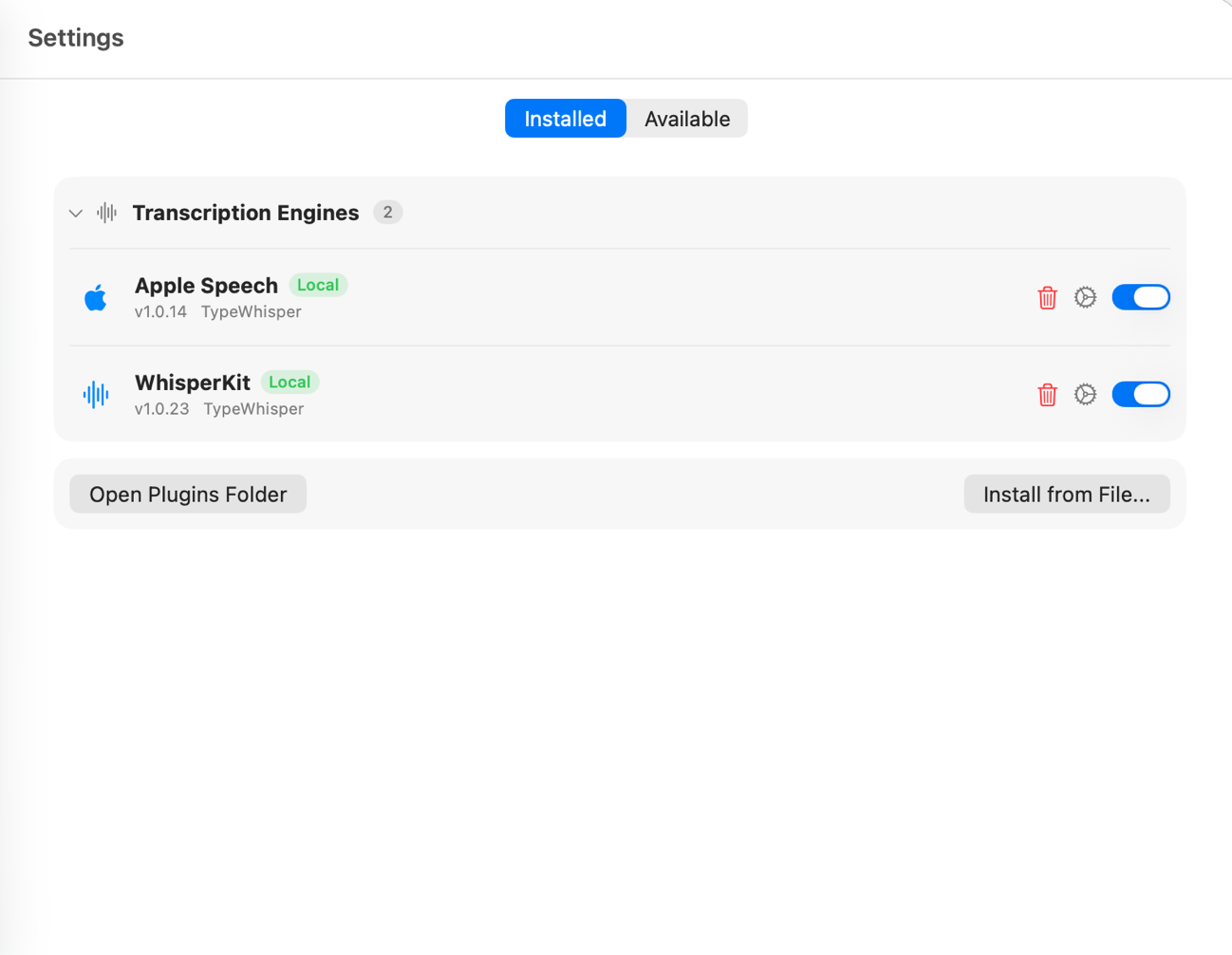

5-8. Integrations(連携・プラグイン)

文字起こしエンジンやLLM、外部アプリとの連携機能をプラグインとして追加・管理します。「Installed(インストール済み)」と「Available(利用可能)」の2タブに分かれています。

Availableタブのローカル(Local)カテゴリには、Obsidianとの連携プラグインがあります。インストールすると文字起こし結果を直接Obsidianのノートとして保存できるようになります。Obsidianをメインのノートアプリとして使っている場合は非常に相性が良い設定です。

クラウド(Cloud)カテゴリではGemini、Claude、ChatGPTなどのLLMをWorkflowsの処理エンジンとして連携させることができます。

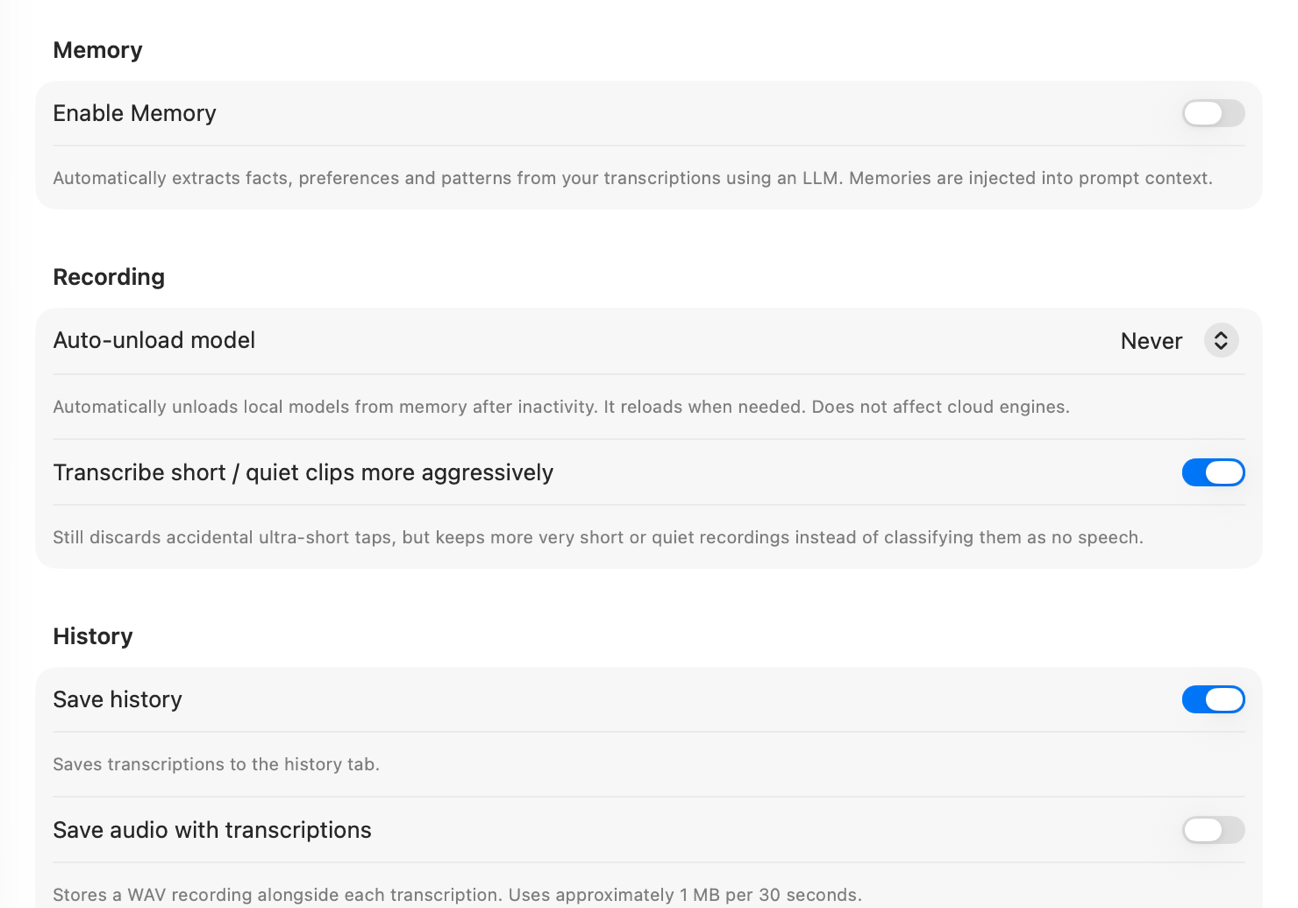

5-9. Advanced(詳細設定)

Auto-unload model(モデルの自動解放):使用しない時間が続いた際にモデルをメモリから解放するタイミングを設定します。メモリが64GBあるなら「Never(解放しない)」にしておくのがお勧めです。次回呼び出し時に待ち時間ゼロで即座に文字起こしが始まります。

Transcribe short / quiet clips more aggressively:短い音声や小さな声も積極的に文字起こしする設定です。ボソッとつぶやいたメモを確実に拾いたい場合はオンにします。

Save history(履歴の保存):文字起こしのテキストを履歴タブに保存します。オンにしておくと後から内容を見返せます。

Save audio with transcriptions(音声ファイルの保存):テキストと一緒に音声ファイル(WAV)も保存する設定です。オンにすると後から録音を聞き返せますが、30秒あたり約1MBの容量を消費します。

Enable API Server(APIサーバー):外部ツールからTypeWhisperを操作するためのサーバー機能を有効にします。Raycastとの連携にはこれをオンにする必要があります。

Install Command Line Tool(CLIツール):ターミナルからTypeWhisperを操作できるCLIツールをインストールします。Keyboard Maestroとの自動化連携で活用します。

Raycast Extension(Raycast連携):「Open in Raycast」ボタンからRaycastへの拡張機能を設定できます。

6. 生産性を上げる外部連携

Raycast連携:アプリを開かずに録音を開始する

MacのランチャーアプリRaycastをお使いなら、TypeWhisperとの連携は設定しておく価値があります。Advanced設定で「Enable API Server」をオンにしてから「Open in Raycast」ボタンを押すと、RaycastにTypeWhisperの拡張機能が追加されます。

これを設定すると、TypeWhisperのウィンドウを開かずにRaycastから直接録音を開始できます。過去の文字起こし履歴をRaycastの検索画面からサッと探してクリップボードにコピーすることも、プロファイル(設定セット)の切り替えも、Raycastから完結します。アプリを行き来する手間が大幅に減ります。

iPhoneのボイスメモを帰宅後に一括変換

File Transcriptionの監視フォルダー機能と組み合わせると、こんな運用が組めます。外出先でiPhoneのボイスメモに録音したファイルをiCloud経由で同期しておき、帰宅後にMacの監視フォルダーへ移動するだけで自動的に文字起こしが始まる、という流れです。出力をMarkdown形式にしておけばそのままObsidianへ取り込めます。

Keyboard Maestro × CLI:全自動化への入口

Advanced設定の「Install Command Line Tool」でCLIをインストールすると、ターミナルからTypeWhisperを操作できるようになります。TypeWhisperのアプリ画面を開かずに、コマンド一行で文字起こしを実行できます。

Keyboard MaestroのExecute Shell Scriptアクションにこのコマンドを組み込むと、「ショートカットを押す→話す→文字起こし結果がObsidianの指定ノートに書き込まれる」という一連の流れを自動化できます。

また第3章で紹介したEnable Translationのオン/オフも、KMのショートカットに割り当てておけば瞬時に切り替えられます。「メモを取るときはオフ」「メールを書くときはオン」をキーひとつで切り替えられれば、この機能が本当の意味で使いこなせるようになります。これが今の私が目指している運用です。

7. 使って感じた、正直なデメリット

良いことばかり書いてもフェアではないので、実際に感じた問題点も正直にお伝えします。

Large v3はM1 Max 64GBでも遅延がある:「Recommended」バッジが付いているLarge v3でも、私の環境では体感できる遅延がありました。話してから文字が出るまでに間がある。Large v3 Turboに切り替えてからその問題は解消しましたが、自分の環境に合うモデルは実際に試してみないと分かりません。

モデルの切り替えに数分かかる:ロードできるのは1モデルのみで、切り替えに数分かかります。「精度が必要な時だけLarge v3を使う」という使い分けは現実的ではありません。最初に1本選んで、それを使い続ける前提で考えた方が良いです。

ダウンロードに1日かかることがある:サーバーの混雑状況に左右されます。HuggingFace Tokenを取得してから臨んでも、タイミングによっては何度もエラーになります。時間的な余裕がある時に取り組んでください。

CLIの導入にはターミナル操作の知識が必要:Keyboard Maestroとの自動化連携は強力ですが、CLIの設定にはある程度ターミナルの知識が必要です。

「爆速」はLarge v3 Turbo限定の話:ネット上で見かける「TypeWhisperは爆速」という評判は、Turboモデルを使った場合の話です。モデル選択を間違えると期待外れになりかねません。

おわりに

4つのアプリを渡り歩いた末にTypeWhisperに落ち着いた理由は、「無料で、時間帯に左右されず、自分のMacの中だけで完結する」この一点に尽きます。

インストールには手間がかかりました。正直「もう有料アプリに戻ろうか」と思った瞬間もありました。でも一度動き出してしまえば、思考のスピードで文字が出てくる爽快感は本物です。ClaudeやGeminiとのチャットで長い指示を送る時も、ブログのアイデアをメモする時も、今では音声入力が手放せなくなっています。

File Transcriptionはまだ試せていないので、使い込んだら続報をお伝えします。

TypeWhisperについて疑問や「自分の環境ではこうだった」という体験があれば、ぜひコメントで教えてください。

おおきに。

LEAVE A REPLY